【StableVideoDiffusion】ComfyUI環境でのAI動画生成

こんにちはシステム制作部の山下です。

11月22日にStability.ai社よりStableVideoDiffusionが発表されました。

発表当初はGoogle Colab環境で動作する情報はあったのですが、どうやらComfyUI環境にModelを読み込むことでローカル環境でも生成可能なようなのでチャレンジしてみます。

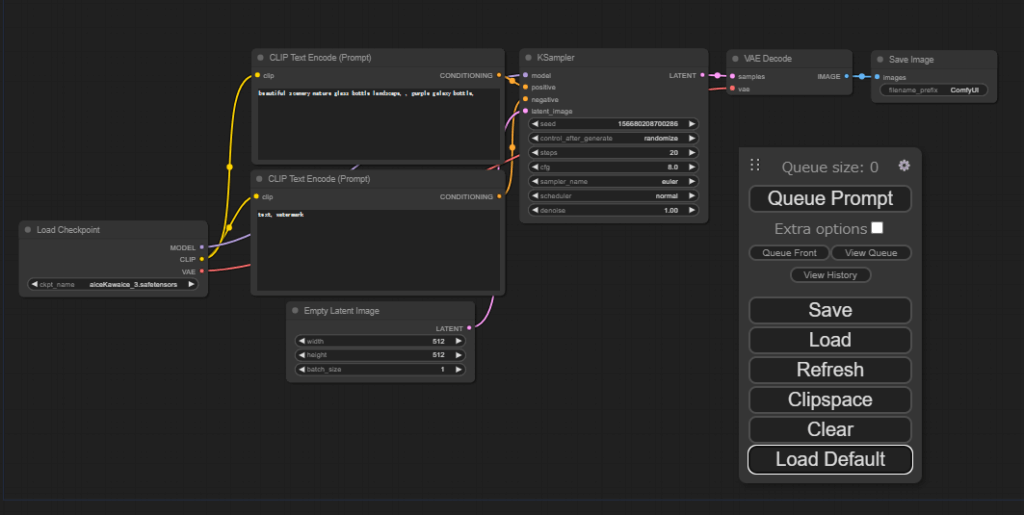

ComfyUIとは?

ComfyUIはWindowsおよびMac上でStableDiffusionを実行するためのUIで操作画面がノードベースで構成されていることが特徴です。

StableDiffusionのローカル環境は現状Automatic1111(stable-diffusion-webui)が主流となっていますがComfyUIも視覚的に全体を把握しやすいので使ってみると案外使いやすそうです。

また、今回はComfyUIの導入方法に関しては省略させていただきます。

Modelのダウンロード

ComfyUIでStableVideoDiffusionを動作させるためにModelファイルとworkflowが必要です。

両方ともComfyUIのGitHubの動画生成参考ページから入手可能です。

Modelは14フレームで生成するModelと25フレームで生成するModelがありますのでリンク先からダウンロードしてください。

フレームとは1秒間に表示されるコマ数のことで14フレームであれば1秒間に14枚、25フレームであれば1秒間に25枚となりより緻密なアニメーションとなりますが、1枚当たりの生成時間は増加します。

14フレームのModel

https://huggingface.co/stabilityai/stable-video-diffusion-img2vid/blob/main/svd.safetensors

25フレームのModel

https://huggingface.co/stabilityai/stable-video-diffusion-img2vid-xt/blob/main/svd_xt.safetensors

ダウンロードが完了したら

ダウンロードしたsvd.safetensorsをComfyUIのインストールフォルダ->models->checkpointsに移動します。

ワークフローのダウンロード

WorkflowはComfyUIに読み込むことで実行したい環境を設定してくれるJSONファイルです。

こちらも動画生成参考ページから入手可能です。

記事を読むと画像をアップロードして動画を生成するパターンと、テキストから動画を生成するパターンの2パターンがあるようなので今回は画像から動画を生成するパターンを試してみます。

「Workflow in Json format」というリンクを右クリックして保存するとJSON形式の設定ファイルがダウンロードできます。

実際に動画生成してみる

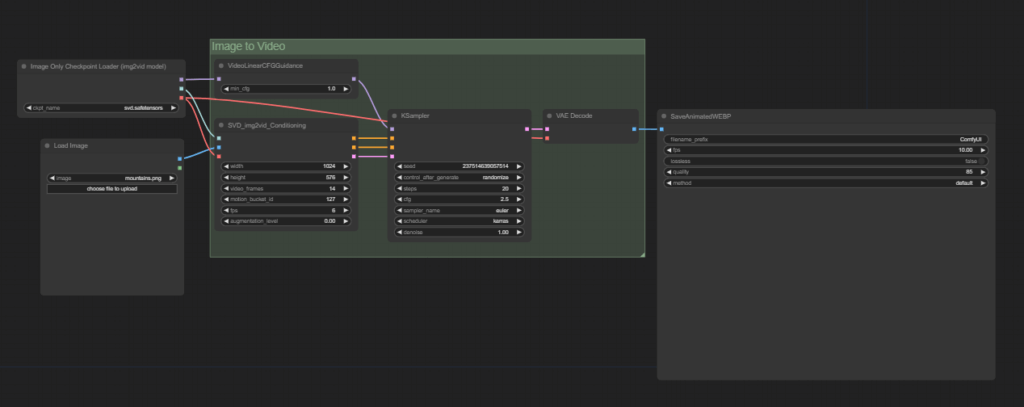

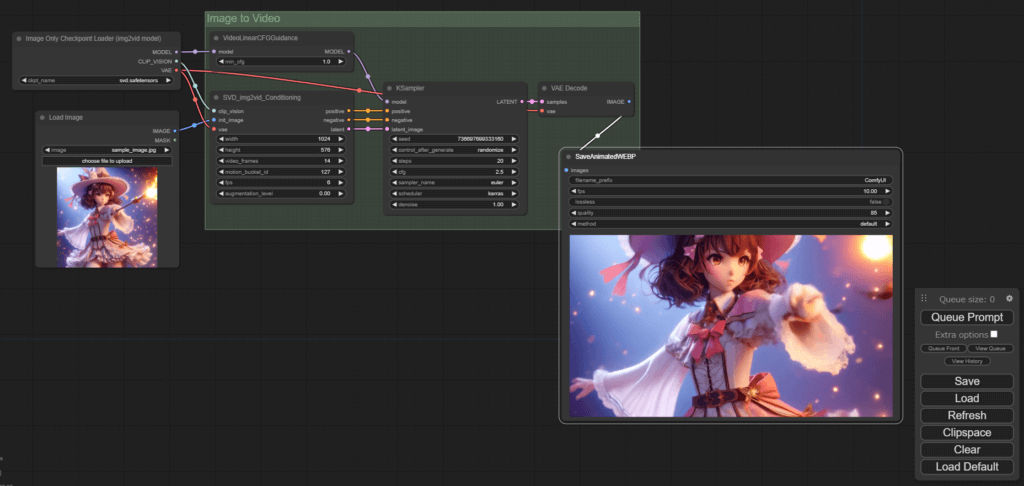

ComfyUIを起動したらダウンロードしたWorkflowファイルを実行中のブラウザにドラッグ&ドロップします。

真ん中にimage to Videoという緑色のウィンドウの配置されたノードが読み込まれます。

生成対象となる画像を左下の「Load Image」の枠内にドラッグ&ドロップします。

のっぺりとした2Dのイラストの動画化は難しいようで2Dイラストの場合奥行きのあるような3DCGライクな画像を選択すると成功しやすいです。

画像選択後右下の「QueuePrompt」ボタンを押して動画生成を開始します。

動画生成には社内のRTX3060を搭載したPCで3分ほどかかりました。

生成後のwebp形式の画像ファイルが出力されます。

実際の映像は以下となります。

1秒ほどの映像ですが立体的にアングルが切り替わっていますね。

画像から動画生成まで自前で生成できてAI関連の技術革新の速さに驚かされるばかりです!

以上、ComfyUI環境によるAI動画生成でした。